人工智能文學 在代碼與想象的交匯處

當我們談論“人工智能文學”與“人工智能基礎軟件開發”,這看似是兩個獨立的領域——前者關乎人文與藝術創造,后者則扎根于嚴謹的數學與工程邏輯。在當今科技與人文日益融合的浪潮下,二者正以前所未有的深度相互交織、相互塑造,共同描繪著未來智能時代的全新圖景。

一、人工智能文學:機器的“創造性”表達

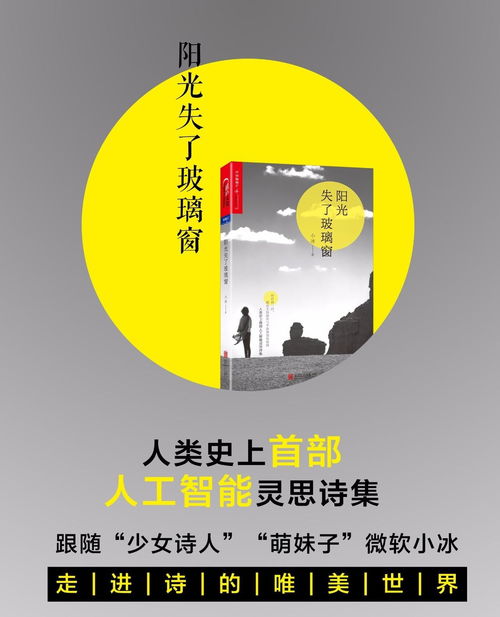

人工智能文學,狹義上指由人工智能系統生成或深度參與的文學創作,包括詩歌、小說、劇本、散文等。其核心驅動力,正是植根于基礎軟件開發中一系列關鍵技術:

- 自然語言處理(NLP):這是溝通文學與代碼的橋梁。從早期的基于規則和模板的生成,到如今基于Transformer架構的大語言模型(如GPT系列),NLP技術使機器能夠理解人類語言的復雜結構、語義和情感。模型通過學習海量的人類文學作品,捕捉其中的風格、韻律、敘事模式,從而生成具有連貫性甚至一定“創造性”的文本。

- 深度學習與神經網絡:生成對抗網絡(GAN)、循環神經網絡(RNN)及其變體(如LSTM),以及當下主導的Transformer,構成了AI文學創作的“大腦”。它們通過多層次的抽象表示,學習文本的內在規律與潛在空間,使得從續寫一句話到構思一個完整故事成為可能。

- 內容生成與風格遷移:基礎算法不僅生成文本,還能模仿特定作家(如莎士比亞、魯迅)的文風,或融合多種風格進行創新。這背后是復雜的模型微調、提示工程和可控生成技術的支撐。

AI文學引發的思考遠超技術本身:它挑戰了關于作者、原創性、靈感與意識的人文傳統觀念。機器創作的作品是否擁有“靈魂”?它是工具,是合作者,還是潛在的獨立創作者?這些問題的探討,本身已成為一種獨特的“元文學”現象。

二、人工智能基礎軟件開發:為創造力構建基石

支撐AI文學發展的,是一整套龐大且精密的基礎軟件棧。這遠不止是調用一個API那么簡單:

- 核心框架與庫:TensorFlow、PyTorch等深度學習框架提供了構建和訓練NLP模型的底層基礎設施。Hugging Face的Transformers庫等則將這些前沿模型民主化,讓開發者能夠便捷地調用和微調強大的預訓練模型,極大地降低了文學生成應用的門檻。

- 算力基礎設施與分布式訓練:訓練能夠理解并生成復雜文本的大模型,需要巨大的計算資源。GPU/TPU集群、云計算平臺以及高效的分布式訓練軟件,是承載這些“數字大腦”的物理和虛擬基礎。沒有這些,千億參數級別的模型無從談起。

- 數據處理與治理工具:高質量的文學數據是AI的“養料”。數據清洗、標注、增強以及負責任的數據治理軟件,確保了訓練數據的規模與質量,直接影響生成文本的多樣性和可靠性。

- 評估與對齊工具:如何評價AI生成的文學作品?這需要開發專門的評估指標和軟件(如衡量流暢性、連貫性、新穎性的工具),以及將模型行為與人類價值觀(安全性、無害性)對齊的技術(如基于人類反饋的強化學習RLHF)。

三、交匯與未來:協同進化的新范式

二者的融合正催生出令人興奮的新模式:

- 人機協同創作:作家利用AI作為“靈感加速器”或“腦力倍增器”,突破思維定式,探索敘事可能性。AI負責提供初稿、建議情節走向、生成不同風格的片段,人類則負責頂層設計、深度潤色和注入真正的情感與思想深度。

- 互動與個性化敘事:基于AI的動態敘事生成技術,可以創造出根據讀者選擇實時變化情節的互動小說、游戲劇本,實現真正的“千人千面”的閱讀體驗。這需要極強的實時生成和上下文管理軟件開發能力。

- 文學研究的新工具:AI可以用于文本分析、風格計量、作者歸屬判定、趨勢預測等,為文學批評和研究提供數據驅動的全新視角。

- 基礎軟件的“人文反饋”:文學應用作為最復雜、最具開放性的NLP任務之一,不斷暴露出基礎模型的局限(如邏輯矛盾、深層語義理解不足、缺乏真正常識)。這為AI基礎軟件的研究與開發提供了至關重要的反饋和挑戰,推動其向更理解人類語境、更可靠的方向發展。

人工智能文學與人工智能基礎軟件開發,如同一枚硬幣的兩面,一面閃耀著人類對機器智能的終極幻想——創造美與意義;另一面則是實現這一幻想的、腳踏實地、一行行代碼構建的工程現實。它們之間的關系并非單向的“工具與應用”,而是正在形成的協同進化生態。隨著基礎軟件能力的持續突破,AI或許能生成更具顛覆性和藝術感染力的作品;人類對文學創作本質的不斷追問與探索,也將反過來指引AI基礎技術向著更智能、更符合人性需求的方向深化。在這個交匯處,我們不僅是在開發技術或創作文本,更是在共同探索智能與創造力的邊界,重新定義數字時代的人文表達。

如若轉載,請注明出處:http://m.yaozer.cn/product/2.html

更新時間:2026-05-08 05:35:58